- HOME

- トピックス一覧(プレスリリース)

- トピックス詳細(プレスリリース)

トピックス詳細(プレスリリース)

東京都市大学

東京都市大学(東京都世田谷区、学長:三木 千壽)環境学部 環境創生学科の史 中超教授は、ドローンの低層リモートセンシング技術と深層学習を用いた地物自動認識技術を開発しました。

近年、深刻度を増す少子高齢化や労働力不足により、農林業の現場においても手入れの困難化等、さまざまな問題が生じています。我が国では、これらを解決し持続可能な農林業を実現するため、リモートセンシングやICTなどの先端技術を駆使しながら、作業の効率化や安全性の向上などを目指す「スマート林業」、「スマート農業」の取り組みが推進されています。今回開発した技術は、ドローンによるリモートセンシングと人工知能の最も高度な手法である深層学習のアルゴリズムを用いたプラットフォームの構築で、検証した対象物の認識率が約90%に達するなど、高精度であることが最大の特徴です。

今後は、より多種類の対象物の自動認識に適応できるようプラットフォームの進化を図り、実用化を目指していきます。なお、これらの研究成果は5月16日(月)~18日(水)にオンラインで開催されたInternational Symposium on Remote Sensing 2022(ISRS 2022)にて発表しました。

本研究のポイント

-

地物自動認識プラットフォームの構築

-

ドローン低層リモートセンシング×深層学習による地物認識プラットフォームの開発

-

スマート林業・スマート農業への適応

概要

リモートセンシング(Remote Sensing)(※1)は、人工衛星や航空機、ドローンなどを用いて、広範囲の大気や地表の状況を瞬時(かつ、同地域を繰り返し定期的)に観測できるという特徴を持つため、植生分布の把握、土地利用・土地被覆マップの作成、地表面形状の観測、水質・水温の観測、雲や雨などの気象状況の観測など、幅広い分野に活用されています。

近年、ドローン技術の進歩により、低層(通常地面から300メートル以下の空間を指す)でのリモートセンシング技術とのその応用が非常に注目されています。特に2015年以降、深層学習(Deep Learning) (※2)をリモートセンシングデータに適用し、対象物を自動抽出する技術の開発が盛んに行われています。

この度、東京都市大学 環境学部 環境創生学科の史 中超教授と同研究室の学生らは、ドローン低層リモートセンシングと深層学習を用いた地物自動認識技術(プラットフォーム)を開発し、東京都市大学横浜キャンパスにある竹林の調査を試みました。

本研究ではセマンティックセグメンテーション(Semantic Segmentation)(※3)という人工知能(AI)の最も高度な手法である深層学習のアルゴリズムを用いて対象物の認識を行います。セマンティックセグメンテーションはU-net(全層畳込みネットワーク)(※4)を利用します。

主な処理プロセスは以下の通りです。

〇対象画像の分割を行い、分割された画像に対してラベル付けを行い、トレーニングデータセットを作ります。

〇トレーニングデータセットを用いて、学習させます。

〇画像認識・検証を行います。

セマンティックセグメンテーションは、画像内の画素にラベルを付けるため、従来の対象物検出や分類の方法に比べ、高精度に達することができることが特徴として挙げられます。

以下に竹の自動認識を例として、本プラットフォームの仕組みを紹介します。

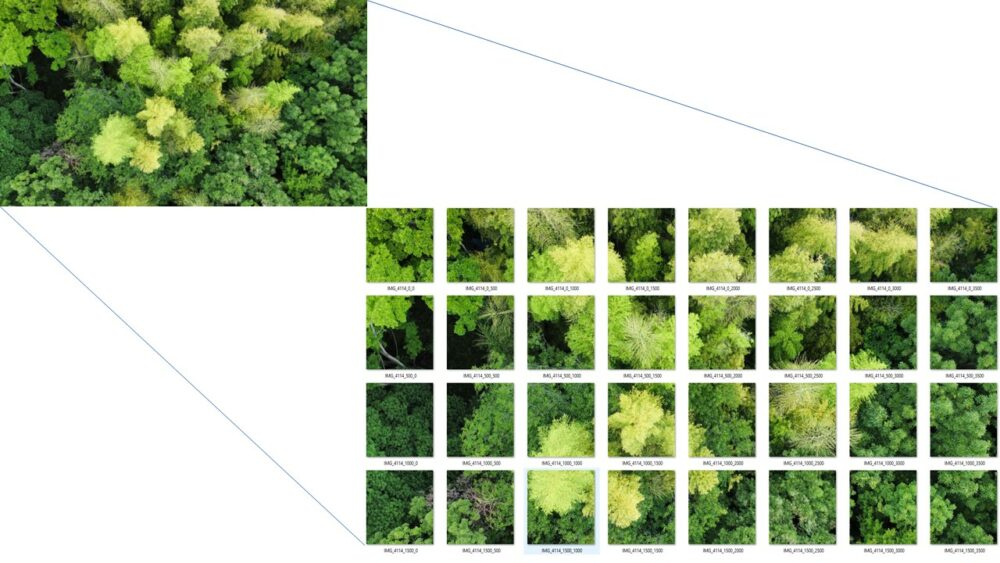

・ステップ1:ドローンにより画像を撮影し、画像分割を行います(図1)。

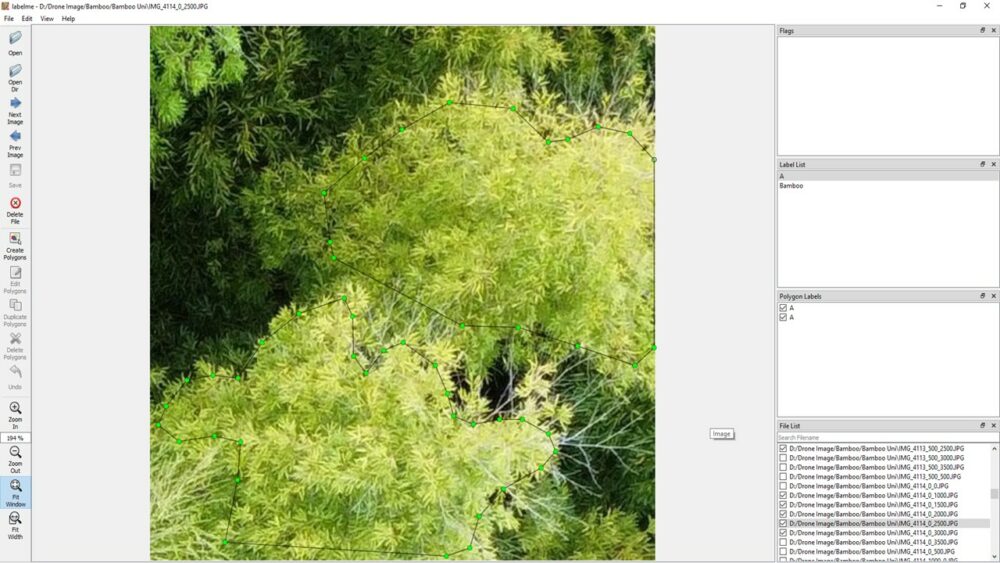

・ステップ2:ラベリング作業(アノテーション)によりトレーニングデータ(教師データ)セットを作成します(図2)。

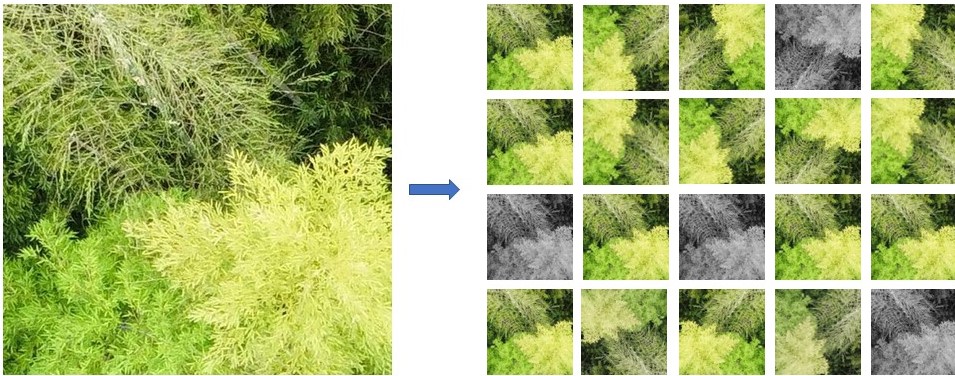

・ステップ3:画像変換処理を行います。より多くのデータセットを獲得し、特徴を充実させ、モデルの過剰適合を防ぐために、十分なデータセットを用意する必要があります。本プラットフォームでは、回転、左右交換、斜め四角形変化、垂直ひずみ、拡大・縮小、弾性ねじれ、輝度変換等の方法を用いてデータセットを充実させます(図3)。

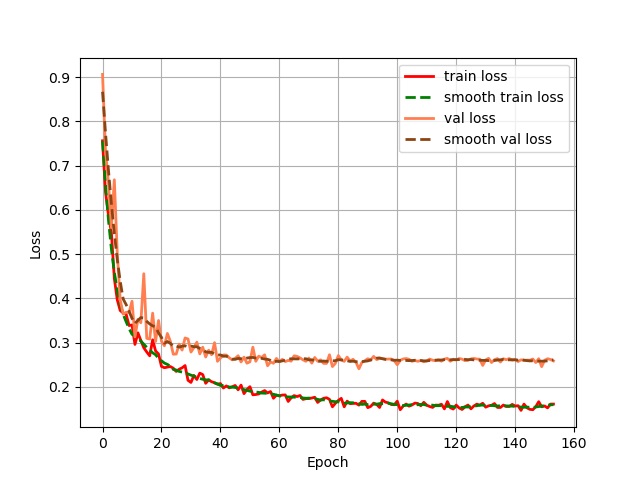

・ステップ4:トレーニングを行い、検証のためトレーニングのロスの推移を記録していきます。図4に示すように、トレーニングの初期段階では、lossの低下が早く、トレーニングラウンドが100回になると、ほぼ安定したペースで推移していることが分かります。

・ステップ5:認識を行い、結果を検証します(図5)。今回の実証実験では、672枚のデータセットを作り、深層学習によりトレーニングおよび実証実験を行い、検証を行った結果、竹の認識率が90.27%に達し、実用化レベルまでに近づいたと言えます。

今回撮影に使用したドローンはDJI mini 2(スペック:離陸重量199g、超高画質4K動画、風圧抵抗 レベル5、最大伝送距離6 km)です(図6)。

また、これらの研究成果は5月16日(月)~18日(水)にオンラインで開催されたリモートセンシングの国際会議International Symposium on Remote Sensing 2022(ISRS 2022)で発表しました。

図1 ドローン画像と分割の結果

図2 アノテーション

図3 画像の変換処理

図4 トレーニングおよびlossの変化

a) ドローン画像

b)認識の結果(黒い箇所は竹のある場所)

図5 ドローン画像における竹の認識結果

図6 DJI mini 2(ドローン)

研究の背景

日本の農林業従事者数は減少傾向にあり、その高齢化も歯止めがかからない状況にあることから、持続可能な農林業を実現するためには、先端技術を駆使したスマート農業やスマート林業の展開が必要不可欠となっています。近年、産官学連携等を通じて、このスマート農業やスマート林業への政策面での推進・サポート、実用化・普及に向けた技術開発・実証実験などが行われています。

スマート農業やスマート林業を実現するには、センシング技術をはじめ、ICT技術やAI技術などの活用が大変重要です。特に、衛星やドローンなどを活かしたリモートセンシング技術の活用が注目を浴びています。

こうした背景のもと、本研究グループは2015年ごろからドローンセンシング技術とAI技術を利用した地物自動認識技術(プラットフォーム)の開発に取り組み始めました。2019年に産学連携プロジェクトとして企業から受託研究を受け、研究開発を大きく前進させました。

研究の社会的貢献および今後の展開

本研究で開発されたプラットフォームは、作物や果物、樹木などの生育状況・数等の把握から、病害の早期発見など幅広い分野に利用することが可能です。すでに、受託研究の成果として依頼元の企業に技術提供も行い、国際論文も発表しております。今後、2件の学術論文を投稿する予定もあり、近い将来、スマート農業やスマート林業などの分野で、より多種類の対象物の自動認識に適応・応用して、認識率を向上させ、実用化を目指していきます。

補足

<ドローン映像>

DJI Mini 2で撮影された実験現場の映像を以下「都市大公式You Tubeチャンネル」よりご覧いただけます。

URL:https://youtu.be/Tg_ik_mN1R8

<論文発表情報>

S. C. Von, Z. Shi, A Study on Automatic Tree Detection Using Drone Images and Deep Learning Method, International Symposium on Remote Sensing 2022, May 16-18, 2022, pp141-144.

<受託研究情報>

「AIによる稲の病気の自動認識システムの開発」, 日本スーパーマップ株式会社, 2019-2021

用語解説

※1 リモートセンシング(Remote Sensing):

リモートセンシングとは、対象物を触らずに、離れたところから物体の形状や性質などを観測する技術である。人工衛星や航空機、ドローンなどに搭載したセンサーを用いて、大気、海、森林、町などから反射したり、自ら放射する電磁波等を観測し、物体ごとの特性を利用して、その識別を行う技術である。

※2 深層学習(Deep Learning):

人間の神経細胞の仕組みを再現したニューラルネットワークを用いた機械学習の手法の一つであり、ラベル付けされたデータ(トレーニングデータ)を用いて自動的に学習を行い、対象物を認識する仕組みである。

※3 セマンティックセグメンテーション(Semantic Segmentation):

画像を画素レベルで識別するための深層学習を用いた画像認識技術である。

※4 U-Net(全層畳込みネットワーク):

U-netは全層畳込みネットワーク(FCN: Fully Convolutional Networks)の1つであり、画像セグメンテーションのためのネットワークである。

<取材申し込み先>

学長室(広報担当)(E-mail:toshidai-pr@tcu.ac.jp)